Daves erste UK-Tour seit vier Jahren, begleitend zu seinem aktuellen Album The Boy Who Played the Harp, erforderte ein Produktionsdesign, das sich flexibel an die Wendungen der Show anpassen konnte. Die Videospezialisten von Universal Pixels lieferten ein dynamisches Screen- und Mediaserver-System, das mit der Performance Schritt halten und die narrative Ebene der Show visuell unterstützen sollte.

Nach früheren Kooperationen arbeitete Universal Pixels erneut mit Video Director und Show Creative Matt Askem, Licht- und Showdesigner Tim Routledge, Produktionsleiter Paddy Hocken sowie Sam Ridgway von Neg Earth Light, der für Rigging und Automation verantwortlich war, zusammen.

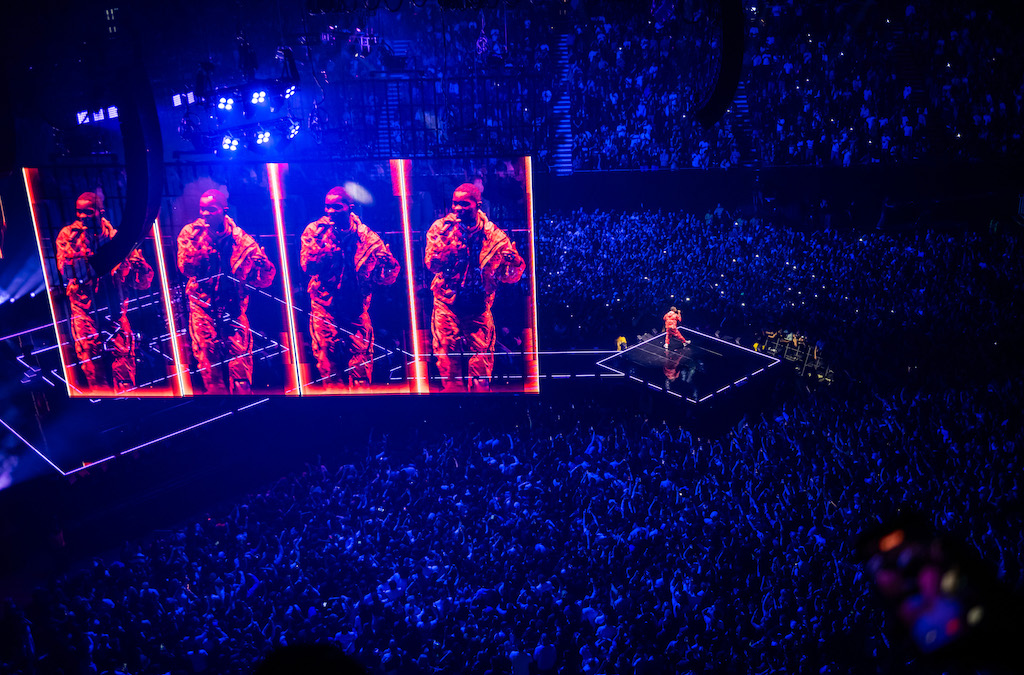

Im Zentrum des Videodesigns standen acht bewegliche Tracking-Screens, die über der Bühne aufgehängt waren und während der Performance ihre Position und Ausrichtung veränderten. Das System basierte auf einem Echtzeit-Workflow, der Automation, Tracking und Content-Rendering miteinander verband: Positionsdaten der bewegten Screens wurden direkt an Disguise GX 3 Mediaserver übertragen. Diese aktualisierten kontinuierlich ein digitales Modell der Bühne, wobei die Inhalte framegenau neu berechnet und angepasst wurden.

Anstatt vordefinierte Cues abzuspielen, berechnete das System fortlaufend neu, wie Inhalte in Abhängigkeit von Position und Winkel der einzelnen Screens dargestellt werden sollten, sodass die räumliche Kohärenz auch bei Bewegung erhalten blieb.

„Wir hatten im Prinzip einen digitalen Zwilling der realen Welt, und das System berechnete für jedes einzelne Bild den korrekten Content“, erklärte James Morden, Technical Specialist bei Universal Pixels. Mit einer Bildrate von 50 Frames pro Sekunde stellte das System sicher, dass Inhalte präzise mit den Bewegungen der Screens synchronisiert wurden, während die Latenz gering genug blieb, um eine stimmige Verbindung zwischen Bewegung und Bild zu gewährleisten. „Man spielt nicht einfach Inhalte ab, sondern reagiert in Echtzeit auf Bewegungen und stellt sicher, dass das, was das Publikum sieht, im Raum immer Sinn ergibt“, so Morden weiter.

Die Disguise GX 3 Server übernahmen die Wiedergabe, Tracking-Daten, Live-Kamera-Feeds sowie generative Inhalte über Notch. Dadurch konnte das System dynamisch auf Licht-, Audio- und Performance-Cues reagieren. Die visuellen Inhalte der Show wurden über die Disguise-Software Designer programmiert, sequenziert und gesteuert. Dieses Integrationsniveau ermöglichte Effekte, die auf der präzisen Abstimmung zwischen physischer Bewegung und gerendertem Content basierten, darunter Layering, Transparenzen und kontrollierte Lichtzustände, durch die Inhalte zeitweise massiv und in anderen Momenten nahezu unsichtbar erschienen.

(Bild: Timmsy)

(Bild: Timmsy)

Die Tiefenwirkung entstand durch die Kombination aus Screen-Design, Content und Licht. Die verwendeten ROE Visual Vanish V8T Panels mit 60 Prozent Transparenz und hoher Helligkeit ermöglichten es, Licht und Bildinhalte durchzulassen und über mehrere Ebenen hinweg miteinander interagieren zu lassen. Durch Bewegungen der Screens und wechselnde Lichtzustände entstanden so variable Transparenz- und Sichtbarkeitsstufen. Zusätzlich wurden zwei weitere ROE Visual Vanish V8T Screens als statische I-Mag-Flächen eingesetzt, ebenfalls gespeist über Disguise Mediaserver und betrieben mit Tessera SX40 LED-Prozessoren von Brompton Technology.

Ergänzend kamen sechs Panasonic AK-UC4000 4K-Studiokameras zum Einsatz, darunter zwei auf ferngesteuerten motorisierten Dollies vom Typ Junior 5, sowie sechs Blackmagic Micro Studio 4K G2 Kameras für Schnittbilder. Die Bildsignale wurden von Askem über eine Kula PPU von Universal Pixels gemischt und in das Serversystem eingespeist, wodurch Echtzeitbilder für die Mediaserver und Screens bereitgestellt wurden.

Die Aufzeichnung im V-Log-Modus ermöglichte einen hohen Dynamikumfang, was insbesondere in einer Umgebung mit ständig wechselnden Lichtverhältnissen und Farbtemperaturen entscheidend war. Dadurch erhielt das Team mehr Kontrolle bei der Anpassung der Kamerabilder an gerenderte Inhalte und LED-Ausgaben, sodass ein konsistentes Gesamtbild zwischen realen und generierten Elementen gewährleistet werden konnte. „Im Hintergrund läuft viel Farbwissenschaft, um alles konsistent aussehen zu lassen“, erklärte Morden.

Universal Pixels stellte zudem die Videoinfrastruktur für die Performance bereit. Ein verteiltes CCTV-System mit mehreren Kameras und Monitoren ermöglichte es Band und Crew, die Position des Künstlers auf Hauptbühne, Catwalk und B-Stage jederzeit zu verfolgen.

Die Zusammenstellung eines eingespielten Teams war entscheidend für die Umsetzung, Anpassung und Weiterentwicklung der Show im Verlauf der Tour. Universal Pixels arbeitete gemeinsam mit Matt Askem und Paddy Hocken an der Auswahl der Crew, zu der unter anderem gehörten:

• Video Crew Chief: Al Bolland

• Server Programmer/Operator und Colour Specialist: Richard Turner

• Video Engineer: Briony Margetts

• Lead LED: Al Wright

• Head of Cameras: Patrick Hall

• LED- und Kamera-Crew: Jules Blagg, Paul Borthwick und Oscar Winter

Auch über die Show hinaus berücksichtigte Universal Pixels praktische Anforderungen. Maßgeschneiderte Transportlösungen wurden entwickelt, um Auf- und Abbau effizienter zu gestalten, indem mehrere Rack-Systeme in einzelnen Einheiten gebündelt wurden. Das bewegliche Screen-Design erhöhte zudem die Anforderungen an Strom- und Datenverteilung und erforderte ein Konzept, das trotz permanenter Bewegung stabile Bedingungen gewährleistete.

Die erfolgreiche Umsetzung basierte auf enger Abstimmung zwischen den Gewerken. Frühe Tests, kontinuierliche Kommunikation und laufende Optimierungen waren entscheidend, um die Systemstabilität in einem komplexen, beweglichen Setup sicherzustellen. „Im Zweifel lieber noch einmal telefonieren und sicherstellen, dass alles funktioniert, bevor es weitergeht“, so Morden. Auch in den finalen Phasen der Tour wurden weitere Feinabstimmungen vorgenommen: „Es ist dieser kontinuierliche Anspruch, das System so nah wie möglich an die Perfektion zu bringen.“

Für Universal Pixels zeigt die Tour die Fähigkeit, komplexe Echtzeit-Videosysteme in einer großen Touring-Produktion umzusetzen. Echtzeit-Rendering, Tracking-Integration und Live-Farbverarbeitung arbeiteten als einheitliches System zusammen und unterstützten die kreativen Inhalte, ohne die Technologie selbst in den Vordergrund zu stellen. Die Umsetzung auf diesem Niveau unterstreicht neben der technischen Kompetenz auch die Fähigkeit, in komplexen und zeitkritischen Produktionsumgebungen zuverlässig zu arbeiten.

universalpixels.com